你怎么知道你正在看一只狗?你是对的几率有多大?如果你是一个机器学习算法,你会筛选数千张图像和数百万个概率,以得出“真实”答案,但不同的算法会采取不同的路线来到达那里。

康奈尔大学和宾夕法尼亚大学的研究人员合作找到了一种方法来处理如此大量的数据,并表明最成功的深度神经网络在相同的“低维”空间中遵循类似的轨迹。

“有些神经网络采取不同的路径。它们以不同的速度运行。但令人惊讶的是,它们都以相同的方式运行,”康奈尔大学团队的领导者、艺术与科学学院的物理学教授詹姆斯·塞斯纳(James Sethna)说。

该团队的技术有可能成为确定哪些网络最有效的工具。

该小组的论文“许多深度网络的训练过程探索相同的低维流形”发表在《美国国家科学院院刊》上。主要作者是宾夕法尼亚大学的毛家林。

该项目源于凯瑟琳·奎因 (Katherine Quinn) 开发的一种算法,该算法可用于对大型概率数据集进行成像并找到最基本的模式,也称为取零数据的极限。

塞斯纳和奎因之前曾使用这种“复制理论”来梳理宇宙微波背景数据,即宇宙早期留下的辐射,并根据不同宇宙的可能特征绘制出我们宇宙的质量。

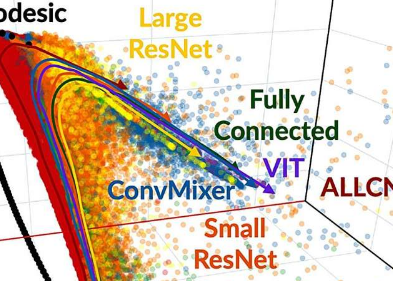

奎因的“偷偷摸摸的方法”,正如塞斯纳所说,产生了三维可视化“以看到这个极高维空间中真正的底层低维模式”。

这些研究结果发表后,宾夕法尼亚大学的普拉蒂克·乔杜里 (Pratik Chaudhari) 联系了塞斯纳,并提议合作。

“Pratik 意识到我们开发的方法可以用来分析深度神经网络的学习方式,”Sethna 说。

几年来,研究人员密切合作。Chaudhari 的团队在探索深度神经网络方面拥有丰富的知识和资源,率先找到了计算可视化的快速方法,并与 Sethna 的团队一起致力于可视化、分析和解释这个机器学习的新窗口。

研究人员重点研究了六种类型的神经网络架构,包括 Transformer(ChatGPT 的基础)。总而言之,该团队训练了 2,296 个深度神经网络配置,这些网络具有不同的架构、大小、优化方法、超参数、正则化机制、数据增强和权重随机初始化。

“这确实体现了当今机器学习标准的广度,”合著者兼博士后研究员伊泰·格里尼亚斯蒂(Itay Grinianasty)说。

对于训练本身,神经网络检查了 50,000 张图像,并为每张图像确定了它属于 10 个类别之一的概率:飞机、汽车、鸟、猫、鹿、狗、青蛙、马、船或卡车。每个概率数都被视为一个参数或维度。因此,50,000 张图像和 10 个类别的组合产生了 50 万个维度。

尽管有这个“高维”空间,奎因算法的可视化表明,大多数神经网络在相同的相对较低的维度上遵循类似的测地线预测轨迹——从对图像的完全无知到其类别的完全确定。实际上,即使采用不同的方法,网络的学习能力也遵循相同的弧线。

“现在我们无法证明这一定会发生。这是令人惊讶的事情。但那是因为我们只花了二十年的时间,”塞斯纳说。“这激励我们在神经网络上做更多的理论工作。也许我们的方法将成为了解不同算法的人们的工具,让他们猜测哪种算法会更好。”

共同作者包括博士生 Han Kheng Teoh 以及来自宾夕法尼亚大学和杨百翰大学的研究人员。

标签:

免责声明:本文由用户上传,如有侵权请联系删除!